Que empresas tecnológicas estadounidenses como Apple fabricaran sus productos en China parecía hasta hace poco una jugada empresarial maestra.

La ecuación era sencilla: producir en China es más barato y, por ende, mayor es el margen de ganancia.

Pero, quizás sin darse cuenta, las empresas estadounidenses alimentaron por años a sus rivales del futuro.

Produciendo teléfonos móviles, vehículos eléctricos y un largo etcétera para compañías extranjeras, China fue desarrollando unas capacidades industriales, tecnológicas y humanas con las que hoy difícilmente cualquier otro país puede competir.

Si las empresas estadounidenses utilizaban a China para producir barato, China las estaba utilizando de vuelta para apuntalar su desarrollo tecnológico.

No fue casualidad. Kyle Chan, investigador posdoctoral de la Universidad de Princeton, explica que China hizo un esfuerzo muy deliberado para atraer y utilizar empresas como Apple para mejorar toda su economía.

"Nunca fue tan sencillo como decir: 'Vale, vengan a fabricar aquí y se hacen ricos y todos quedamos contentos'. No. En realidad, es como: 'Tienen que contribuir algo al desarrollo de China'".

"Y no solo Apple, sino también Volkswagen, Bosch, Intel, SK Hynix y Samsung", dice Chan.

Los expertos coinciden en que el centro de gravedad de la industria de la tecnología se ha ido desplazando.

Los días en que Estados Unidos era prácticamente el único país con la capacidad de producir tecnología capaz de cambiar la historia de la humanidad terminaron, y lo que hay ahora es una feroz competencia en todos los sectores.

"Ya no se trata de una carrera de un solo caballo", le dice a BBC Mundo Han Shen Lin, director para China de la consultora estadounidense The Asia Group.

¿Cómo pasó?

Apple mudó su producción a China a inicios de los 2000.

En su libro Apple in China: The Capture of the World's Greatest Company ("Apple en China: La captura de la empresa más grande del mundo"), Patrick McGee expone, con base en más de 200 entrevistas a extrabajadores de la compañía, que la decisión de Apple de producir más del 90% de sus productos en China produjo grandes ganancias, pero no solo eso.

"La fortuna de Apple y su sofisticada producción desempeñaron un papel fundamental en la financiación, la capacitación, la supervisión y el abastecimiento de los fabricantes chinos, habilidades que ahora Pekín está utilizando como arma contra Occidente", plantea McGee, que excorresponsal del Financial Times en Silicon Valley.

En esa línea, el profesor Chan explica que, con el tiempo, los proveedores extranjeros que hacían parte de la cadena de producción del iPhone y otros dispositivos de Apple empezaron a ser sustituidos por proveedores chinos.

"Empezando por lo básico, como las partes de cristal —los lentes, las pantallas—, luego pasando por los módulos de la cámara y, finalmente, los chips mismos".

Según un análisis de 2024 hecho por el periódico japonés Nikkei Asia, 87% de los proveedores de Apple tienen plantas de producción en China, y más de la mitad tienen su sede principal en China o Hong Kong.

Aunque Apple ha tratado de diversificar los países donde se fabrican los insumos para sus dispositivos, sigue dependiendo ampliamente de fabricantes chinos y, además, de trabajadores chinos que cobran entre US$1 y US$2 la hora.

McGee se atreve a afirmar que, si quisiera, el gobierno chino podría detener la producción de Apple de la noche a la mañana.

La ecuación era sencilla: producir en China es más barato y, por ende, mayor es el margen de ganancia.

Pero, quizás sin darse cuenta, las empresas estadounidenses alimentaron por años a sus rivales del futuro.

Produciendo teléfonos móviles, vehículos eléctricos y un largo etcétera para compañías extranjeras, China fue desarrollando unas capacidades industriales, tecnológicas y humanas con las que hoy difícilmente cualquier otro país puede competir.

Si las empresas estadounidenses utilizaban a China para producir barato, China las estaba utilizando de vuelta para apuntalar su desarrollo tecnológico.

No fue casualidad. Kyle Chan, investigador posdoctoral de la Universidad de Princeton, explica que China hizo un esfuerzo muy deliberado para atraer y utilizar empresas como Apple para mejorar toda su economía.

"Nunca fue tan sencillo como decir: 'Vale, vengan a fabricar aquí y se hacen ricos y todos quedamos contentos'. No. En realidad, es como: 'Tienen que contribuir algo al desarrollo de China'".

"Y no solo Apple, sino también Volkswagen, Bosch, Intel, SK Hynix y Samsung", dice Chan.

Los expertos coinciden en que el centro de gravedad de la industria de la tecnología se ha ido desplazando.

Los días en que Estados Unidos era prácticamente el único país con la capacidad de producir tecnología capaz de cambiar la historia de la humanidad terminaron, y lo que hay ahora es una feroz competencia en todos los sectores.

"Ya no se trata de una carrera de un solo caballo", le dice a BBC Mundo Han Shen Lin, director para China de la consultora estadounidense The Asia Group.

¿Cómo pasó?

Apple mudó su producción a China a inicios de los 2000.

En su libro Apple in China: The Capture of the World's Greatest Company ("Apple en China: La captura de la empresa más grande del mundo"), Patrick McGee expone, con base en más de 200 entrevistas a extrabajadores de la compañía, que la decisión de Apple de producir más del 90% de sus productos en China produjo grandes ganancias, pero no solo eso.

"La fortuna de Apple y su sofisticada producción desempeñaron un papel fundamental en la financiación, la capacitación, la supervisión y el abastecimiento de los fabricantes chinos, habilidades que ahora Pekín está utilizando como arma contra Occidente", plantea McGee, que excorresponsal del Financial Times en Silicon Valley.

En esa línea, el profesor Chan explica que, con el tiempo, los proveedores extranjeros que hacían parte de la cadena de producción del iPhone y otros dispositivos de Apple empezaron a ser sustituidos por proveedores chinos.

"Empezando por lo básico, como las partes de cristal —los lentes, las pantallas—, luego pasando por los módulos de la cámara y, finalmente, los chips mismos".

Según un análisis de 2024 hecho por el periódico japonés Nikkei Asia, 87% de los proveedores de Apple tienen plantas de producción en China, y más de la mitad tienen su sede principal en China o Hong Kong.

Aunque Apple ha tratado de diversificar los países donde se fabrican los insumos para sus dispositivos, sigue dependiendo ampliamente de fabricantes chinos y, además, de trabajadores chinos que cobran entre US$1 y US$2 la hora.

McGee se atreve a afirmar que, si quisiera, el gobierno chino podría detener la producción de Apple de la noche a la mañana.

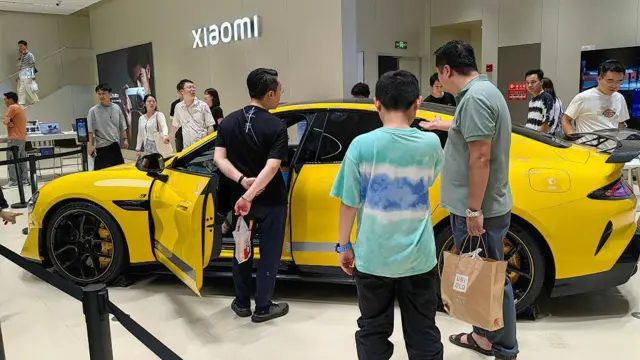

Además de convertirse en el proveedor por excelencia de Apple, China aprendió a desarrollar sus propios teléfonos, vehículos eléctricos y hasta modelos de inteligencia artificial, tan sofisticados como los estadounidenses.

Los ingenieros y las millonarias inversiones de Apple y otras empresas occidentales transfirieron conocimiento y capacidades cruciales para innovar a manos chinas, con lo cual contribuyeron directamente a la emergencia gigantes tecnológicos como Huawei, Xiaomi y BYD, dice McGee en "Apple en China".

Y así llegamos a este momento, en el que, aunque EE.UU. sigue estando a la vanguardia, China tiene sus propios gigantes con los que correr la carrera.

En palabras de Han Shen Lin, "Estados Unidos sigue liderando en las tecnologías fundamentales y los chips avanzados, pero China está acortando distancias rápidamente en innovación y escalabilidad en la capa de aplicaciones".

Kyle Chan agrega: "China ha empezado a sobrepasar a EE.UU. en algunas áreas. Y la gran historia aquí es la velocidad con la que lo está haciendo".

La batalla por la IA

Un sector que refleja como pocos la competencia voraz entre Estados Unidos y China es el de la Inteligencia Artificial, la actual joya de la corona de la industria tecnológica.

A pesar de que China ha invertido decididamente en el desarrollo de la IA por décadas, Estados Unidos parecía estar muy por delante con GPT-3, el revolucionario modelo de lenguaje lanzado por la compañía estadounidense OpenAI en 2020,

Y los posteriores lanzamientos de las distintas versiones de ChatGPT, cada una mejor que la anterior, conquistaron el mundo.

Pero entonces, cuando pocos lo esperaban, en enero de este año apareció en el panorama DeepSeek, un chatbot chino muy parecido a ChatGPT. Desarrollarlo, según sus creadores, costó una pequeña fracción de lo que le costó su competidor.

Donald Trump se refirió a la noticia como "un llamado de atención" para la industria tecnológica en EE.UU.

"Lo importante no era solo que, de repente, un modelo chino fuera casi tan bueno como los mejores modelos estadounidenses, ni que se hubiera logrado con menos recursos informáticos y, según ellos, a un costo mucho menor, sino también —y esto es realmente crucial— que se haya hecho desafiando las restricciones a la exportación de chips para IA", afirma Chan.

Desde 2022, EE.UU. impide que clientes chinos compren los codiciados chips H100 de Nvidia, los más avanzados que existen para entrenar sistemas de IA.

En su lugar, Nvidia produce versiones menos potentes de sus chips específicamente dirigidas a sus clientes en China.

Por eso, para Chan, el lanzamiento de un chatbot chino que le pudiera competir a su contraparte estadounidense era un asunto "patriótico". "Para los chinos, se trataba de un desafío a la supremacía estadounidense", considera.

Deepseek afirma que entrenó su modelo de lenguaje usando los chips desmejorados de Nvidia que se venden en el mercado chino, pero hay rumores de que el fundador de la compañía habría comprado una gran cantidad de chips H100 y los habría combinado con otros menos sofisticados.

En abril, el presidente Donald Trump prohibió las exportaciones del chip H20, el más avanzado que para entonces se permitía vender a China, alegando riesgos para la seguridad nacional.

Recientemente, permitió que se reanuden a cambio de que la empresa le dé al gobierno estadounidense el 15% de sus ventas en China, un acuerdo sin precedentes en el que, además, recaen dudas sobre su legalidad.

Las restricciones de EE.UU. a las exportaciones han obligado a las compañías chinas a buscar alternativas.

Para el profesor Chan, medidas como estas "son efectivas en el corto plazo en términos de ralentizar el desarrollo de China, pero en el mediano a largo plazo, impulsan los esfuerzos de ese país para producir su propia tecnología y cadena de suministro independientes".

Un ejemplo de ello es lo que ocurrió con Huawei, que en 2019 fue añadida a la "Lista de Entidades" que participan en "actividades contrarias a la seguridad nacional o los intereses de la política exterior de EE.UU." tras acusaciones de espionaje, robo de propiedad intelectual y vigilancia de datos.

Debido a ello, los teléfonos móviles de la compañía dejaron de poder usar el sistema operativo Android, de Google.

"Después de sufrir el golpe, Huawei pasó varios años desarrollando su propio sistema operativo y sus propios chips SoC. No creo que lo hubieran hecho a tan gran escala si no hubieran sido sancionados tan duramente por Estados Unidos y, esencialmente, siendo obligados a hacerlo", señala Chan.

Las ventajas de China

Estados Unidos llegó a ser el líder de la tecnología por la fortaleza de su sector privado, por los grandes incentivos económicos que hay en el país para innovar, por la gran cantidad de energía que produce, entre otras condiciones.

Entonces, ¿cuáles son las ventajas de China?

Los expertos apuntan, por un lado, a su decidida apuesta por una política industrial que invierte recursos del Estado para desarrollar aquellos sectores que considera estratégicos.

Chan plantea en diálogo con BBC Mundo que, mientras que en EE.UU. las inversiones se mueven rápidamente de acuerdo con el mercado, en China el gobierno se atiene a sus planes a largo plazo e invierte consistentemente en ellos, incluso si no le generan réditos inmediatos.

Además, "China tiene un sistema que fomenta una competencia interna muy, muy feroz, en el que los gobiernos locales respaldan sus propias empresas locales y se crea una especie de torneo", dice Chan.

Esa intensa competencia interna produce unos jugadores que logran ser competitivos no solo en China sino también a nivel global.

Otra palabra que mencionan repetidamente los expertos para explicar las ventajas que tiene China en la carrera tecnológica es "magnitud", la magnitud de su población y de los datos que hay sobre esa población.

"China puede poner a prueba tecnologías emergentes con toda su población", señala Han Shen Lin, director para China de The Asia Group.

Por ejemplo, "la capacidad de los fabricantes de medicamentos chinos para reclutar pacientes mucho más rápidamente y aprovechar las bases de datos nacionales centralizadas de pacientes ha acelerado mucho el ritmo de los ensayos clínicos y el descubrimiento de fármacos en China, especialmente en el ámbito de la oncología", decribe Chan.

Todo eso parece poner a China en una posición al menos tan privilegiada como la de EE.UU. para definir el futuro de la tecnología.

Al preguntarle a Lin qué pistas de ese futuro observa en su vida en Shanghái, afirma: "Lo que más me sorprende es cómo la tecnología avanzada se integra a la perfección en la vida cotidiana, desde la logística basada en inteligencia artificial hasta el pago sin efectivo en todo tipo de transacciones".

Sin embargo, advierte que el camino que sigue China no es uno sin riesgos.

"Sin la colaboración y la aceptación de muchos países a nivel global, especialmente en materia de cuáles son los estándares, China corre el riesgo de quedar encerrada una cámara de eco".

Y agrega: "Por ello, China ha ampliado su alcance en el Sur Global mediante iniciativas como la Iniciativa de la Franja y la Ruta, y ha tratado de dominar los organismos que definen los estándares en organizaciones multilaterales como la ONU".

Los expertos apuntan, por un lado, a su decidida apuesta por una política industrial que invierte recursos del Estado para desarrollar aquellos sectores que considera estratégicos.

Chan plantea en diálogo con BBC Mundo que, mientras que en EE.UU. las inversiones se mueven rápidamente de acuerdo con el mercado, en China el gobierno se atiene a sus planes a largo plazo e invierte consistentemente en ellos, incluso si no le generan réditos inmediatos.

Además, "China tiene un sistema que fomenta una competencia interna muy, muy feroz, en el que los gobiernos locales respaldan sus propias empresas locales y se crea una especie de torneo", dice Chan.

Esa intensa competencia interna produce unos jugadores que logran ser competitivos no solo en China sino también a nivel global.

Otra palabra que mencionan repetidamente los expertos para explicar las ventajas que tiene China en la carrera tecnológica es "magnitud", la magnitud de su población y de los datos que hay sobre esa población.

"China puede poner a prueba tecnologías emergentes con toda su población", señala Han Shen Lin, director para China de The Asia Group.

Por ejemplo, "la capacidad de los fabricantes de medicamentos chinos para reclutar pacientes mucho más rápidamente y aprovechar las bases de datos nacionales centralizadas de pacientes ha acelerado mucho el ritmo de los ensayos clínicos y el descubrimiento de fármacos en China, especialmente en el ámbito de la oncología", decribe Chan.

Todo eso parece poner a China en una posición al menos tan privilegiada como la de EE.UU. para definir el futuro de la tecnología.

Al preguntarle a Lin qué pistas de ese futuro observa en su vida en Shanghái, afirma: "Lo que más me sorprende es cómo la tecnología avanzada se integra a la perfección en la vida cotidiana, desde la logística basada en inteligencia artificial hasta el pago sin efectivo en todo tipo de transacciones".

Sin embargo, advierte que el camino que sigue China no es uno sin riesgos.

"Sin la colaboración y la aceptación de muchos países a nivel global, especialmente en materia de cuáles son los estándares, China corre el riesgo de quedar encerrada una cámara de eco".

Y agrega: "Por ello, China ha ampliado su alcance en el Sur Global mediante iniciativas como la Iniciativa de la Franja y la Ruta, y ha tratado de dominar los organismos que definen los estándares en organizaciones multilaterales como la ONU".

/cloudfront-eu-central-1.images.arcpublishing.com/prisa/7EXQTDHWSVDVDPC6TDIQTSHWUQ.jpg)

/cloudfront-eu-central-1.images.arcpublishing.com/prisa/J22STK6ANJG6NBG5AP34QHV3LA.jpg)

/cloudfront-eu-central-1.images.arcpublishing.com/prisa/QNGPT3KR3NCV3HZUEHIS5UZAKM.jpg)

/cloudfront-eu-central-1.images.arcpublishing.com/prisa/H7DYW7LBQBB2PKTEPRI7YBOKS4.jpg)